Der EU AI Act schafft erstmals europaweit verbindliche Anforderungen für den Einsatz von Systemen Künstlicher Intelligenz (KI): Produktsicherheitsrechtlich unannehmbare Anwendungen werden untersagt, zukunftsträchtige, aber hochrisikobehaftete KI‑Systeme werden an verbindliche Standards und Anforderungen gebunden, alle anderen KI-Systeme werden in sehr geringem Umfang reguliert (Dokumentations- und Transparenzpflichten). Das Gesetz trat bereits zum 01. August 2024 in Kraft und wird schrittweise voraussichtlich bis zum 02. August 2027 gestaffelt in Kraft treten.

Im Jahr 2026 rückt die Risikostufe „Hochrisiko-KI-Systeme“ in den Fokus der Aufmerksamkeit: Am 2. August 2026 treten die zentralen Vorgaben des EU AI Act für sogenannte Hochrisiko-KI-Systeme in Kraft. Ab diesem Zeitpunkt dürfen KI-Systeme dieser Risikostufe nur noch entwickelt und betrieben werden, wenn die EU‑AI-Act-Vorgaben erfüllt sind. KI-Anbieter werden verpflichtet, umfassende Dokumentationen vorzulegen und Konformitätsbewertungen durchzuführen.

Ab August 2026 werden die zuständigen Aufsichtsbehörden (in Deutschland voraussichtlich die Bundesnetzagentur in Zusammenarbeit mit Fachbehörden wie BaFin und Landesstellen) die Einhaltung kontrollieren.

Organisationen, die bereits KI nutzen oder dies planen, sollten sich jetzt mit den Anforderungen vertraut machen und ihre Prozesse und Datenstrategien rechtzeitig an die neuen Vorgaben anpassen.

Überblick: Was ist der EU AI Act?

Der EU AI Act ist das weltweit erste umfassende Gesetz zur Regulierung von Künstlicher Intelligenz. Ziel des Gesetzes ist es, KI-Systeme sicher und transparent zu machen, Grundrechte zu schützen und zugleich Innovation zu fördern.

Der EU AI Act schafft klare Spielregeln für alle, d. h. jedes Unternehmen in der EU, das KI nutzt oder nutzen möchte, ist betroffen – unabhängig von Größe oder Branche. Es werden mithin nicht nur die Entwicklung und der Vertrieb reguliert, sondern auch die Realisierung von Risiken im Rahmen der eigenverantwortlichen Verwendung, sprich dem Betrieb von KI-Systemen. Das Gesetz gilt somit auch für kleine und mittlere Betriebe, allerdings mit Erleichterungen wie z. B. vereinfachte Verfahren und Unterstützung durch sogenannte Regulatory Sandboxes zur Durchführung von Tests.

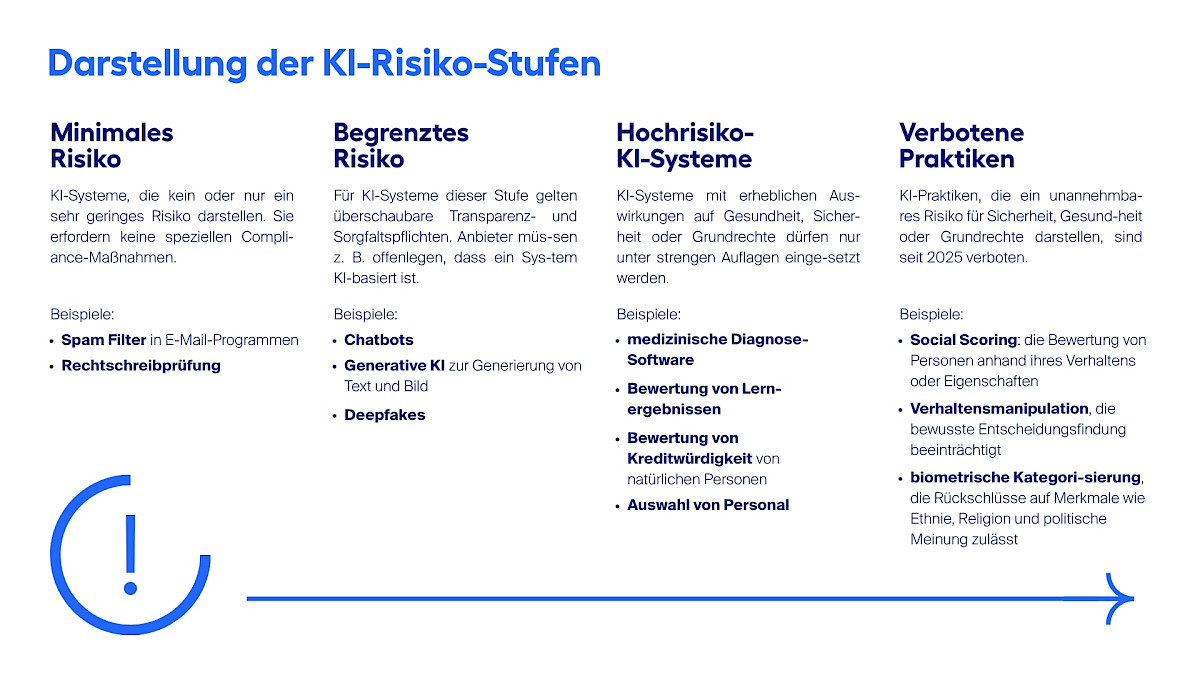

Kern des EU AI Act ist ein risikobasierter Ansatz: Je höher das Risiko, das von einer KI-Anwendung ausgeht, desto strenger die Regeln. So müssen Hochrisiko-KI-Systeme, wie z. B. KI-Systeme, die zur Kreditwürdigkeitsprüfung von natürlichen Personen bestimmungsgemäß eingesetzt werden, während des gesamten KI-Lebenzyklus durch eine menschliche Aufsicht mit effektiven Eingriffsmöglichkeiten überwacht werden. Einfache KI-Systeme, wie z. B. Spam-Filter, werden in der Regel geringeren Anforderungen unterliegen. Verboten sind nur wenige, besonders unannehmbare, gefährliche KI-Praktiken, wie z. B. manipulative Überwachungstechnik.